[비즈니스포스트] 인공지능(AI) 전용 칩 전쟁이 본격화되면서 삼성전자 파운드리(반도체 위탁생산)로 공급선 다변화가 이뤄질 것이란 전망이 나왔다.

김동원 KB증권 연구원은 15일 “글로벌 빅테크의 AI 전용 칩 출시 르네상스 시대가 열리고 있다”며 “AI 전용 칩을 출시하는 이유는 에너지 효율 개선과 ‘그래픽처리장치(GPU) + 고대역폭메모리(HBM)’ 의존도를 탈피하기 위함”이라고 분석했다.

![KB증권 "빅테크 AI칩 전쟁 본격화, 삼성전자 파운드리로 공급선 다변화"]()

최근 구글 클라우드는 연례 기술 콘퍼런스인 ‘클라우드 넥스트 24’에서 AI 전용 반도체인 TPU의 신제품(TPU v5p)을 공개했고, 인텔은 4월9일 기업설명회에서 신형 AI 가속기 ‘가우디3’를 선보였다.

메타와 애플은 AI 서비스 강화를 위해 각각 자체 AI 반도체 MTIA 2세대와 M4를 공개했고, 삼성전자도 AI 반도체인 마하1 개발을 완료한데 이어 마하2 개발에도 착수한 것으로 전해진다.

김 연구원은 “빅테크들이 자체 AI 반도체를 개발하는 이유는 엔비디아 중심의 공급구조에서 높은 가격을 지불함에도 원하는 시기에 충분한 하드웨어 공급을 받기가 어렵고, 각 업체들이 요구하는 기능이 하드웨어에 맞지 않기 때문”이라고 설명했다.

자체 AI 칩을 출시한 빅테크들은 모두 에너지 효율에 방점을 두고 있다.

구글은 TPU v5p가 유사한 하드웨어 대비 60% 더 나은 에너지 효율성이 있다고 밝혔다. 네이버와 AI 생태계를 공동 구축하는 인텔 가우디3은 엔비디아 H100 대비 40% 전력 효율 개선을 강조하고 있다.

24시간 가동해야 하는 AI 전용 데이터센터는 전기 먹는 하마와 같다.

생성형 AI 서비스 (챗GPT)는 일반 검색 엔진보다 최대 30배 많은 전력이 필요하다. 이에 따라 빅테크 업체들의 AI 전용 칩 출시 전쟁은 전성비를 통한 에너지 효율이 최대 목표인 것으로 볼 수 있다.

자체 AI 칩은 GPU+HBM 의존도 탈피하기 위한 목적도 있다.

엔비디아 GPU의 리드타임(주문부터 제품 수취 소요 시간)은 3~6개월에 이르고, HBM 조달도 병목 현상에 처했다. HBM이 고대역 폭으로 고속 데이터를 다루기 좋지만, 현재 빅테크를 중심으로 AI 데이터센터 경쟁에 직면한 상황에서 긴 리드타임은 약점으로 작용한다.

빅테크의 AI 전용 칩은 현재 TSMC로부터 100% 생산되고 있다.

하지만 TSMC의 생산능력은 2025년부터 수요를 전부 감당할 수 없을 것으로 전망된다. 따라서 올해 하반기부터 삼성전자 파운드리로 AI 전용 칩 공급선 다변화가 빠르게 이뤄질 가능성이 있다.

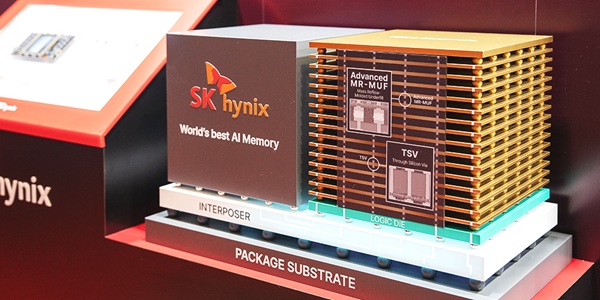

김 연구원은 “향후 수년간 지속될 빅테크 업체들의 천문학적 규모의 AI 데이터센터 투자 확대는 반도체 및 전기 확보가 최대 이슈가 될 전망”이라며 “삼성전자, SK하이닉스, 가온칩스 등을 최선호주로 제시한다”고 말했다. 나병현 기자

김동원 KB증권 연구원은 15일 “글로벌 빅테크의 AI 전용 칩 출시 르네상스 시대가 열리고 있다”며 “AI 전용 칩을 출시하는 이유는 에너지 효율 개선과 ‘그래픽처리장치(GPU) + 고대역폭메모리(HBM)’ 의존도를 탈피하기 위함”이라고 분석했다.

▲ 빅테크의 AI칩 전쟁이 본격화되면서 2024년 하반기부터 삼성전자 파운드리로 공급선이 다변화될 것이란 증권사 분석이 나왔다.

최근 구글 클라우드는 연례 기술 콘퍼런스인 ‘클라우드 넥스트 24’에서 AI 전용 반도체인 TPU의 신제품(TPU v5p)을 공개했고, 인텔은 4월9일 기업설명회에서 신형 AI 가속기 ‘가우디3’를 선보였다.

메타와 애플은 AI 서비스 강화를 위해 각각 자체 AI 반도체 MTIA 2세대와 M4를 공개했고, 삼성전자도 AI 반도체인 마하1 개발을 완료한데 이어 마하2 개발에도 착수한 것으로 전해진다.

김 연구원은 “빅테크들이 자체 AI 반도체를 개발하는 이유는 엔비디아 중심의 공급구조에서 높은 가격을 지불함에도 원하는 시기에 충분한 하드웨어 공급을 받기가 어렵고, 각 업체들이 요구하는 기능이 하드웨어에 맞지 않기 때문”이라고 설명했다.

자체 AI 칩을 출시한 빅테크들은 모두 에너지 효율에 방점을 두고 있다.

구글은 TPU v5p가 유사한 하드웨어 대비 60% 더 나은 에너지 효율성이 있다고 밝혔다. 네이버와 AI 생태계를 공동 구축하는 인텔 가우디3은 엔비디아 H100 대비 40% 전력 효율 개선을 강조하고 있다.

24시간 가동해야 하는 AI 전용 데이터센터는 전기 먹는 하마와 같다.

생성형 AI 서비스 (챗GPT)는 일반 검색 엔진보다 최대 30배 많은 전력이 필요하다. 이에 따라 빅테크 업체들의 AI 전용 칩 출시 전쟁은 전성비를 통한 에너지 효율이 최대 목표인 것으로 볼 수 있다.

자체 AI 칩은 GPU+HBM 의존도 탈피하기 위한 목적도 있다.

엔비디아 GPU의 리드타임(주문부터 제품 수취 소요 시간)은 3~6개월에 이르고, HBM 조달도 병목 현상에 처했다. HBM이 고대역 폭으로 고속 데이터를 다루기 좋지만, 현재 빅테크를 중심으로 AI 데이터센터 경쟁에 직면한 상황에서 긴 리드타임은 약점으로 작용한다.

빅테크의 AI 전용 칩은 현재 TSMC로부터 100% 생산되고 있다.

하지만 TSMC의 생산능력은 2025년부터 수요를 전부 감당할 수 없을 것으로 전망된다. 따라서 올해 하반기부터 삼성전자 파운드리로 AI 전용 칩 공급선 다변화가 빠르게 이뤄질 가능성이 있다.

김 연구원은 “향후 수년간 지속될 빅테크 업체들의 천문학적 규모의 AI 데이터센터 투자 확대는 반도체 및 전기 확보가 최대 이슈가 될 전망”이라며 “삼성전자, SK하이닉스, 가온칩스 등을 최선호주로 제시한다”고 말했다. 나병현 기자

![[한국갤럽] 이재명 지지율 61%로 3%p 내려, 민주당 45% vs 국민의힘 23%](https://businesspost.co.kr/news/photo/202605/20260515114313_87595.jpg)